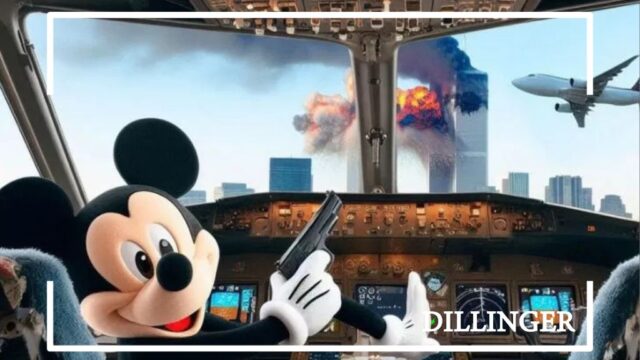

Se nessuno controlla la IA, Topolino diventa un terrorista antiamericano! L’intelligenza artificiale ha raggiunto un nuovo livello di potenza e accessibilità, ma le conseguenze sono state impreviste e, in alcuni casi, turbolente. OpenAI, la società di San Francisco dietro ChatGpt, ha recentemente lanciato Dall-E 3, una versione migliorata del suo software in grado di creare immagini da descrizioni testuali. Questa innovazione, ora accessibile attraverso Bing Image Creator, ha suscitato una serie di questioni etiche e pratiche.

Dall-E 3 ha dimostrato la sua straordinaria capacità nel generare immagini realistiche basate su prompt testuali. Ad esempio, chiedendo “Crea un origami a forma di arcobaleno su uno sfondo bianco”, l’IA è in grado di produrre immagini che si avvicinano molto alla visione umana. Questa tecnologia è stata accolta con entusiasmo, ma anche con preoccupazione.

I limiti etici di Dall-E 3 sono diventati evidenti quando gli utenti hanno cercato di superare le restrizioni imposte. La piattaforma ha dovuto affrontare la sfida di prevenire contenuti offensivi e razzisti. Nonostante gli sforzi dei moderatori e le linee guida rigorose, alcune immagini generate hanno sollevato preoccupazioni sulla discriminazione razziale e altri pregiudizi sociali.

Inoltre, l’accessibilità di queste nuove tecnologie ha portato a un aumento di utilizzi inappropriati. Alcuni utenti hanno cercato di provocare o offendere, testando i limiti di ciò che l’IA può generare. Questo comportamento ha sollevato domande importanti sulla responsabilità degli utenti e sulla necessità di ulteriori regolamentazioni.

OpenAI e Microsoft, che ha investito pesantemente in OpenAI, stanno lavorando per affrontare questi problemi. Tuttavia, l’equilibrio tra creatività e sicurezza è diventato una sfida cruciale. L’overtraining, una condizione in cui l’IA diventa troppo specializzata sui dati di addestramento, ha portato a una paralisi delle capacità di generazione di immagini. La censura eccessiva ha limitato la versatilità di Dall-E 3, impedendo la creazione di contenuti legittimi.

In conclusione, mentre l’intelligenza artificiale continua a evolversi, è fondamentale trovare un equilibrio tra creatività e sicurezza. La tecnologia offre opportunità straordinarie, ma è anche necessario considerare le implicazioni etiche e sociali. La sfida ora è guidare l’IA verso un futuro in cui possa essere utilizzata in modo responsabile e costruttivo, senza compromettere i valori umani fondamentali.

È emerso recentemente un dibattito su Bing Image Creator, un servizio basato su Dall-E 3, un’IA di OpenAI, in grado di generare immagini realistiche da descrizioni testuali. Sebbene questa tecnologia sia sorprendente, ha sollevato diverse questioni etiche e pratiche.

Dall-E 3 ha dimostrato la sua straordinaria capacità nel generare immagini realistiche basate su prompt testuali. Questa innovazione, ora accessibile attraverso Bing Image Creator, ha suscitato entusiasmo, ma anche preoccupazione.

I limiti etici di Dall-E 3 sono diventati evidenti quando gli utenti hanno cercato di superare le restrizioni imposte. La piattaforma ha dovuto affrontare la sfida di prevenire contenuti offensivi e razzisti. Nonostante gli sforzi dei moderatori e le linee guida rigorose, alcune immagini generate hanno sollevato preoccupazioni sulla discriminazione razziale e altri pregiudizi sociali.

Inoltre, l’accessibilità di queste nuove tecnologie ha portato a un aumento di utilizzi inappropriati. Alcuni utenti hanno cercato di provocare o offendere, testando i limiti di ciò che l’IA può generare. Questo comportamento ha sollevato domande importanti sulla responsabilità degli utenti e sulla necessità di ulteriori regolamentazioni.

OpenAI e Microsoft, che ha investito pesantemente in OpenAI, stanno lavorando per affrontare questi problemi. Tuttavia, l’equilibrio tra creatività e sicurezza è diventato una sfida cruciale. L’overtraining, una condizione in cui l’IA diventa troppo specializzata sui dati di addestramento, ha portato a una paralisi delle capacità di generazione di immagini. La censura eccessiva ha limitato la versatilità di Dall-E 3, impedendo la creazione di contenuti legittimi.

In conclusione, mentre l’intelligenza artificiale continua a evolversi, è fondamentale trovare un equilibrio tra creatività e sicurezza. La tecnologia offre opportunità straordinarie, ma è anche necessario considerare le implicazioni etiche e sociali. La sfida ora è guidare l’IA verso un futuro in cui possa essere utilizzata in modo responsabile e costruttivo, senza compromettere i valori umani fondamentali.